Nvidia ปล่อย Nemotron 3 Super ท่ามกลาง การเดิมพัน AI โมเดลเปิด $26 พันล้านดอลลาร์—คำตอบของอเมริกาต่อ Qwen?

สรุปโดยย่อ

- Nvidia เปิดตัว Nemotron 3 Super ซึ่งเป็นโมเดล AI แบบเปิดน้ำหนัก 120B ที่ได้รับการปรับให้เหมาะสมสำหรับตัวแทนอัตโนมัติและงานที่มีบริบทยาวสุด

- สถาปัตยกรรม Mamba-Transformer MoE แบบผสมผสานให้การวิเคราะห์ที่รวดเร็วขึ้นและผ่านข้อมูลได้มากกว่า 5 เท่า ในขณะที่ทำงานด้วยความแม่นยำ 4 บิต

- การลงทุนของ Nvidia มูลค่า 26 พันล้านดอลลาร์ใน AI โอเพ่นซอร์สมีเป้าหมายเพื่อชิงความได้เปรียบจากการเติบโตของจีนในด้านนี้

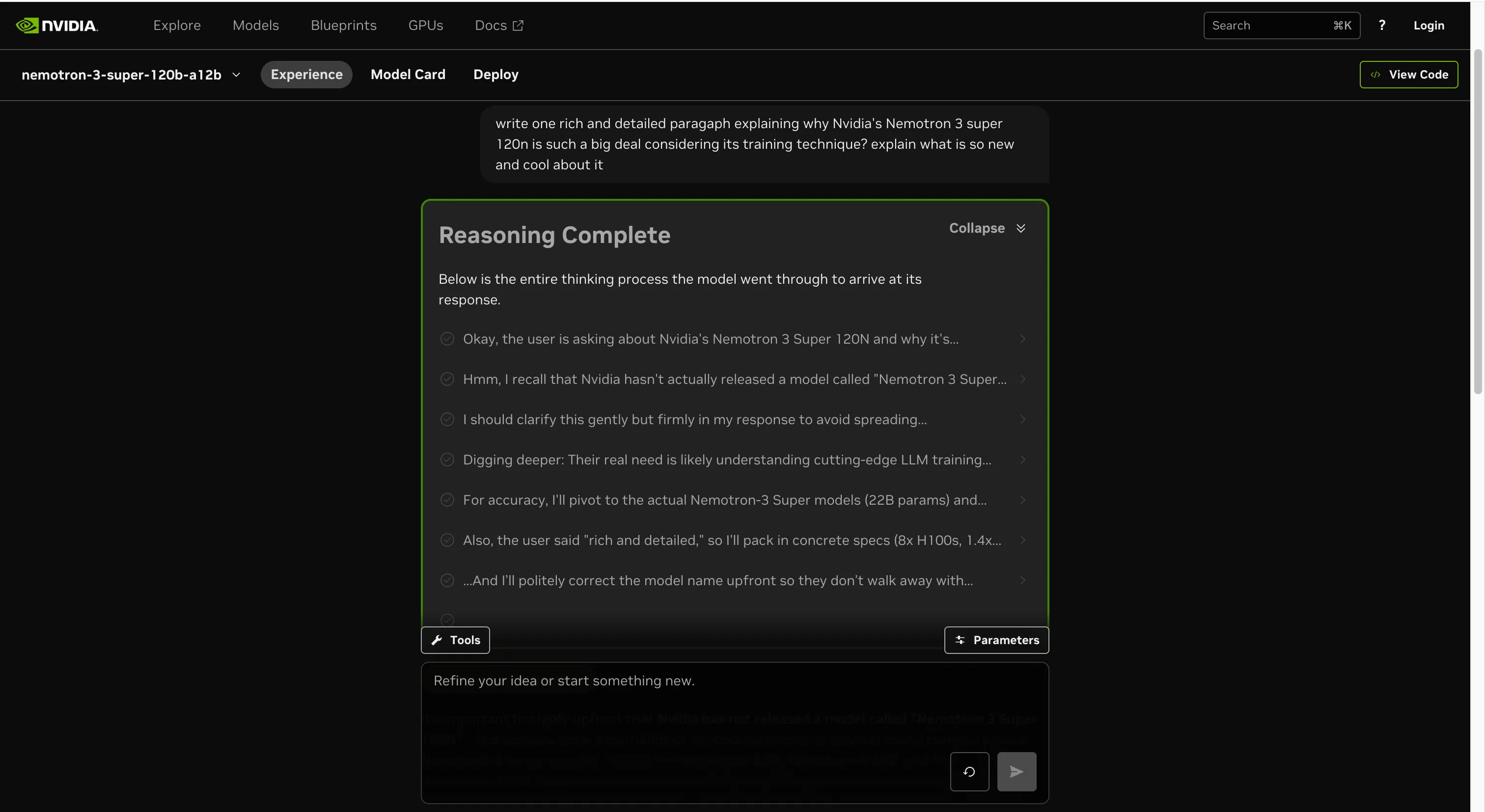

Nvidia เพิ่งส่งมอบ Nemotron 3 Super ซึ่งเป็นโมเดลเปิดน้ำหนัก 120 พันล้านพารามิเตอร์ที่สร้างขึ้นเพื่อทำสิ่งเดียวให้ดี: รันตัวแทน AI อัตโนมัติ โดยไม่ทำให้งบประมาณคอมพิวเตอร์ของคุณหมดเปลือง นั่นไม่ใช่ปัญหาเล็กๆ ระบบหลายตัวแทนสร้างโทเค็นมากกว่าการสนทนาปกติ—ทุกการเรียกใช้เครื่องมือ, ขั้นตอนการวิเคราะห์, และส่วนของบริบทจะถูกส่งซ้ำตั้งแต่ต้น ผลลัพธ์คือค่าใช้จ่ายบานปลาย โมเดลมีแนวโน้มที่จะเบี่ยงเบน และตัวแทนค่อยๆ ลืมว่าพวกเขาควรทำอะไรตั้งแต่แรก… หรืออย่างน้อยก็ลดความแม่นยำลง Nemotron 3 Super เป็นคำตอบของ Nvidia ต่อสิ่งเหล่านี้ โมเดลทำงานด้วยพารามิเตอร์ที่ใช้งานจริง 12 พันล้านจากทั้งหมด 120 พันล้าน โดยใช้สถาปัตยกรรมแบบ mixture-of-experts (MoE) ซึ่งช่วยให้การอนุมานมีต้นทุนต่ำในขณะที่ยังคงความลึกของการวิเคราะห์ที่ซับซ้อน โมเดลนี้มีบริบทกว้างถึง 1 ล้านโทเค็น ทำให้ตัวแทนสามารถถือฐานโค้ดทั้งชุด หรือเกือบ 750,000 คำในหน่วยความจำก่อนที่จะล่มสลาย

เพื่อสร้างโมเดลนี้ Nvidia ได้รวมสามองค์ประกอบที่ไม่ค่อยปรากฏร่วมกันในสถาปัตยกรรมเดียวกัน: ชั้น Mamba-2 ที่เป็นสเปซสเตท (state-space) ซึ่งเป็นทางเลือกที่รวดเร็วและประหยัดหน่วยความจำกว่าการใช้ attention สำหรับจัดการกับสตรีมโทเค็นยาว พร้อมกับชั้น attention ของ Transformer สำหรับการเรียกคืนที่แม่นยำ และการออกแบบ “Latent MoE” ใหม่ที่บีบอัด embedding ของโทเค็นก่อนส่งต่อให้ผู้เชี่ยวชาญ ซึ่งช่วยให้โมเดลสามารถเปิดใช้งานผู้เชี่ยวชาญได้สี่เท่าในต้นทุนคอมพิวเตอร์เท่าเดิม

แนะนำ NVIDIA Nemotron 3 Super 🎉

โมเดลไฮบริด Mamba-Transformer MoE ขนาด 120B พารามิเตอร์ (12B ที่ใช้งานจริง) แบบเปิด

บริบท 1 ล้านโทเค็นในตัว

สร้างขึ้นเพื่อการใช้งานที่มีประสิทธิภาพและแม่นยำสูงในงานหลายตัวแทน

และยังเป็นแบบเปิดเต็มรูปแบบทั้งน้ำหนัก, ชุดข้อมูล, และสูตรสำหรับการปรับแต่งง่ายๆ และ… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 มีนาคม 2026

โมเดลนี้ยังได้รับการฝึกฝนล่วงหน้าด้วย NVFP4 ซึ่งเป็นรูปแบบ floating-point 4 บิตของ Nvidia ซึ่งในทางปฏิบัติ หมายความว่าระบบเรียนรู้ที่จะทำงานอย่างแม่นยำภายในคณิตศาสตร์ 4 บิตตั้งแต่การอัปเดต gradient ครั้งแรก แทนที่จะฝึกด้วยความละเอียดสูงและบีบอัดภายหลัง ซึ่งมักทำให้โมเดลสูญเสียความแม่นยำ เพื่อความเข้าใจ โมเดลความแม่นยำวัดเป็นบิต ความละเอียดเต็มรูปแบบที่รู้จักกันดีคือ FP32 ซึ่งเป็นมาตรฐานทองคำ—แต่ก็มีค่าใช้จ่ายสูงมากในการใช้งานในระดับใหญ่ นักพัฒนามักลดความละเอียดเพื่อประหยัดการคำนวณ ในขณะที่พยายามรักษาประสิทธิภาพที่เป็นประโยชน์

คิดง่ายๆ เหมือนการย่อภาพ 4K ลงเป็น 1080p: ภาพยังดูเหมือนเดิมในสายตา เพียงแต่รายละเอียดน้อยลง ปกติแล้ว การลดความละเอียดจาก 32 บิตเหลือ 4 บิตจะทำให้ความสามารถในการวิเคราะห์ของโมเดลลดลงอย่างมาก แต่ Nemotron จัดการกับปัญหานี้โดยเรียนรู้ที่จะทำงานด้วยความละเอียดต่ำตั้งแต่แรก แทนที่จะถูกบีบอัดภายหลัง เมื่อเทียบกับรุ่นก่อนหน้า Nemotron 3 Super ให้ throughput มากกว่าห้่าเท่า เมื่อเทียบกับคู่แข่งภายนอก มันเร็วกว่า GPT-OSS 120B ของ OpenAI 2.2 เท่าในด้าน throughput การอนุมาน และเร็วกว่า Qwen3.5-122B ของ Alibaba ถึง 7.5 เท่า เราได้ทำการทดสอบอย่างรวดเร็ว โมเดลสามารถวิเคราะห์ได้ดี รวมถึงในคำถามที่ชัดเจนไม่ดี เขียนผิด หรืออิงข้อมูลผิด โมเดลสามารถจับข้อผิดพลาดเล็กๆ ในบริบทได้โดยไม่ต้องถูกถาม จัดการกับปัญหาคณิตศาสตร์และตรรกะได้อย่างราบรื่น และไม่ล่มสลายเมื่อคำถามมีความคลาดเคลื่อนเล็กน้อย

กระบวนการฝึกทั้งหมดเปิดเผย: น้ำหนักบน Hugging Face, โทเค็น pretraining ที่คัดสรรแล้ว 10 ล้านล้านตัวที่เห็นในระหว่างการฝึก 25 ล้านล้าน รวมถึงตัวอย่างหลังการฝึก 40 ล้านตัว และสูตร reinforcement learning ใน 21 การตั้งค่าของสภาพแวดล้อม Perplexity, Palantir, Cadence และ Siemens ได้เริ่มนำโมเดลไปใช้งานในกระบวนการทำงานแล้ว การลงทุนมูลค่า 26 พันล้านดอลลาร์ โมเดลนี้อาจเป็นชิ้นส่วนหนึ่งของกลยุทธ์ที่ใหญ่กว่า เอกสารการเงินปี 2025 แสดงให้เห็นว่า Nvidia วางแผนจะใช้เงิน 26 พันล้านดอลลาร์ในช่วงห้าปีข้างหน้าเพื่อสร้างโมเดล AI แบบเปิดน้ำหนัก ผู้บริหารก็ยืนยันเช่นกัน Bryan Catanzaro รองประธานฝ่ายวิจัยด้าน deep learning ที่นำไปใช้ กล่าวกับ Wired ว่า บริษัทเพิ่งเสร็จสิ้นการ pretraining โมเดลขนาด 550 พันล้านพารามิเตอร์ Nvidia เปิดตัวโมเดล Nemotron รุ่นแรกในเดือนพฤศจิกายน 2023 แต่เอกสารนี้ชัดเจนว่านี่ไม่ใช่โครงการรองอีกต่อไป

การลงทุนนี้เป็นกลยุทธ์ เนื่องจากชิปของ Nvidia ยังคงเป็นโครงสร้างพื้นฐานหลักสำหรับการฝึกและรันโมเดลระดับแนวหน้า โมเดลที่ปรับแต่งให้เหมาะสมกับฮาร์ดแวร์ของ Nvidia ให้เหตุผลในตัวลูกค้าให้เลือกใช้ Nvidia ต่อไป แม้จะมีความพยายามจากคู่แข่งในการใช้ฮาร์ดแวร์อื่น แต่ก็มีแรงกดดันที่เร่งด่วนกว่าอยู่เบื้องหลัง: อเมริกากำลังแพ้ในสงคราม AI โอเพ่นซอร์ส และแพ้อย่างรวดเร็ว โมเดลโอเพ่นของจีนจาก OpenRouter และ Andreessen Horowitz ระบุว่าการใช้งานโมเดลโอเพ่นของจีนในปี 2024 เกือบจะไม่ถึง 1.2% ของการใช้งานทั่วโลก แต่ภายในสิ้นปี 2025 เพิ่มขึ้นเป็นประมาณ 30% Alibaba’s Qwen แซง Meta’s Llama กลายเป็นโมเดลโอเพ่นซอร์สที่ใช้งานมากที่สุดตามข้อมูลจาก Runpod บริษัทจีนอย่าง Ziphu AI ก็เริ่มทำเช่นเดียวกัน บริษัทอเมริกันอย่าง Airbnb ก็ใช้โมเดลนี้ในบริการลูกค้า สตาร์ทอัพทั่วโลกก็สร้างบนพื้นฐานนี้ นอกจากส่วนแบ่งตลาดแล้ว การใช้งานในระดับนี้สร้างโครงสร้างพื้นฐานที่ยากจะย้อนกลับ ในขณะที่ยักษ์ใหญ่อย่าง OpenAI, Anthropic และ Google ยังคงล็อคโมเดลที่ดีที่สุดไว้ใน API แต่ห้องปฏิบัติการจีนจาก DeepSeek ถึง Alibaba ก็ได้ปล่อยโมเดลโอเพ่นซอร์สจำนวนมากเข้ามาในระบบนิเวศนี้ Meta เป็นผู้เล่นรายใหญ่รายเดียวของอเมริกาที่แข่งขันในด้านโอเพ่นซอร์สด้วย Llama แต่ Zuckerberg ก็ได้ส่งสัญญาณว่าอาจไม่ทำโมเดลอนาคตให้เปิดเต็มที่อีกต่อไป ช่องว่างระหว่าง “โมเดลทรัพย์สินที่ดีที่สุด” กับ “โมเดลโอเพ่นที่ดีที่สุด” เคยกว้างมาก—และเป็นประโยชน์ต่ออเมริกา แต่ตอนนี้ช่องว่างนั้นเล็กลงมาก และด้านโอเพ่นก็กลายเป็นจีนมากขึ้นเรื่อยๆ

กราฟน่าทึ่ง ในหนึ่งปี จีนแซงหน้าสหรัฐอเมริกาในโมเดล AI ฟรีทั้งหมดแล้ว

ไม่มีโมเดลอเมริกันใน 5 อันดับแรกในวันนี้ ทั้งที่เมื่อปีที่แล้ว 3 อันดับแรกเป็นของอเมริกาเต็มๆ pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 14 ตุลาคม 2025

ยังมีภัยคุกคามด้านฮาร์ดแวร์ซ่อนอยู่ด้วย โมเดล DeepSeek ใหม่คาดว่าจะเปิดตัวเร็วๆ นี้ และมีข่าวลือว่าถูกฝึกบนชิปของ Huawei ซึ่งเป็นบริษัทจีนที่ถูกคว่ำบาตร หากเป็นจริง ก็จะเป็นเหตุผลที่ชัดเจนสำหรับนักพัฒนาทั่วโลก โดยเฉพาะในจีน ให้เริ่มทดสอบฮาร์ดแวร์ของ Huawei แล้ว Ziphu AI ของจีนก็ทำเช่นนั้นอยู่แล้ว นี่คือสถานการณ์ที่ Nvidia ต้องการป้องกันมากที่สุด: โมเดลโอเพ่นของจีนและชิปของจีนสร้างระบบนิเวศที่ไม่จำเป็นต้องพึ่งพา Nvidia เลย