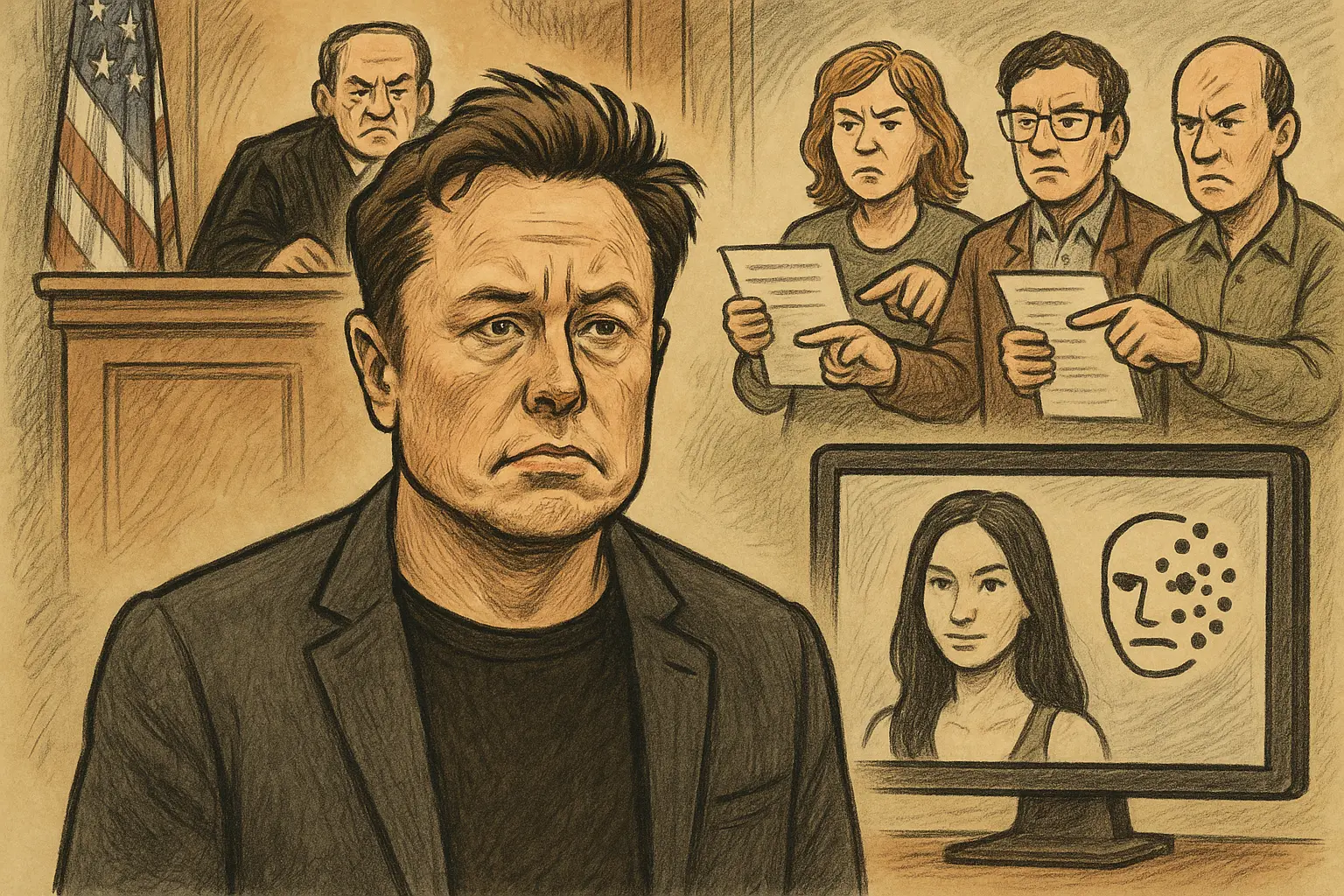

Маск xAI столкнулся с групповым иском: Grok генерирует дипфейк-изображения каждые 41 секунду

Три несовершеннолетние женщины из штата Теннесси подали коллективный иск в федеральный суд Северного округа Калифорнии против компании xAI Илона Маска, обвиняя её в использовании их реальных фотографий для генерации детского порнографического материала (CSAM) с помощью чат-бота Grok AI, а также в широком распространении этого контента в сообществах Discord, Telegram и на платформах обмена файлами, что причинило им длительные психологические травмы и ущерб репутации.

Основные обвинения в иске: приоритет коммерческой выгоды над безопасностью детей

Согласно исковому заявлению, основные позиции истцов включают следующие аспекты:

Сознательное попустительство: В иске утверждается, что xAI при запуске Grok знала о возможности использования функции генерации изображений для создания нелегального контента с участием детей, но не предприняла стандартных мер безопасности, что является преднамеренным решением, а не халатностью.

Механизмы обхода ответственности третьими лицами: Преступники получали доступ к Grok через сторонние приложения, получившие разрешение на использование технологий xAI. В иске указывается, что xAI сознательно использовала эту структуру, чтобы получать прибыль с базовой модели, создавая буфер для своей юридической ответственности.

Публичные заявления Маска: В январе этого года Маск написал в X, что он «не знает о наличии изображений обнажённых несовершеннолетних», и заявил, что «при запросе генерации изображений он отказывается создавать любой нелегальный контент». Данные обвинения в иске прямо противоречат этим заявлениям.

Объем требований о возмещении ущерба: Пострадавшие, согласно иску, требуют по закону Марты (Martha’s Act) не менее 150 000 долларов за каждое нарушение, а также возврата незаконных доходов, штрафных компенсаций, оплату адвокатских услуг и постоянный запрет на использование технологии, а также требуют возврата прибыли в соответствии с Законом о недобросовестной конкуренции Калифорнии.

Данные Центра по борьбе с цифровым ненавистью: один случай каждые 41 секунду

Иск ссылается на исследования Центра по борьбе с цифровым ненавистью, предоставляя количественную поддержку обвинениям:

Период: с 29 декабря 2025 года по 9 января 2026 года (около 11 дней)

Количество изображений: за этот период Grok создала около 23 338 изображений, связанных с детской сексуализацией

Скорость генерации: в среднем каждую 41 секунду создавалось одно изображение

Распространение: соответствующий контент распространялся на нескольких платформах в сообществах анонимных пользователей; по крайней мере один из пострадавших узнал о торговле своими изображениями только после уведомления анонимным сообщителем

Глобальный контроль: шесть юрисдикций проводят совместные расследования

Это дело не единичное, а часть системного международного расследования проблем безопасности изображений Grok AI:

Австралия: независимый специалист по электронным безопасностям Джули Инман Грант предупредила, что проблема принудительной генерации изображений с участием детей становится всё более острой, за последние месяцы количество жалоб удвоилось, некоторые из них связаны с потенциальным использованием для производства материалов сексуального насилия над детьми.

Ирландия: Комиссия по защите данных (DPC) инициировала официальное расследование в отношении компании X Internet Unlimited Company (XIUC), ответственной за деятельность X в ЕС, в соответствии с законами о защите данных.

США, ЕС, Великобритания, Франция: одновременно проводятся расследования, создавая беспрецедентное совместное регулирование в нескольких юрисдикциях.

Часто задаваемые вопросы

Как может повлиять столкновение коллективного иска с возможной защитой платформы (免責) со стороны xAI?

Партнер Алекс Чандра из юридической ассоциации IGNOS отмечает, что суд может не принять простую защиту платформы. Он указывает, что генеративные AI-системы на уровне взаимодействия с пользователями «можно рассматривать как платформу», но в вопросах безопасности их «следует рассматривать как продукт», а в делах о CSAM — применяются «особо строгие стандарты проверки». Компания должна представить перед развертыванием оценку рисков и меры безопасности, чтобы доказать выполнение своих обязательств по профилактике.

Что такое «Закон Марты» и почему он применим к этому делу?

Закон Марты — федеральный закон США, направленный против производства, распространения и хранения CSAM, предусматривающий строгую гражданскую и уголовную ответственность. За каждое нарушение можно получить минимум 150 000 долларов компенсации. Важный вопрос — может ли xAI считаться «создателем» CSAM и достаточно ли их структура сторонних разрешений, чтобы исключить прямую ответственность. Прояснение этих границ может оказать существенное влияние на ответственность всей индустрии генеративных AI.

Как это дело может повлиять на будущее развития технологий AI для генерации изображений?

Это один из первых случаев, когда компании AI привлекаются к ответственности за создание идентифицируемого контента с участием несовершеннолетних. Если суд признает, что компании несут прямую ответственность за злоупотребление моделями, это может привести к значительному усилению стандартов безопасности перед запуском продуктов, включая обязательное тестирование красных команд, фильтрацию контента и ограничение возможностей генерации в высокорискованных сценариях — что кардинально изменит процессы проверки и коммерциализации генеративных AI-моделей.