Infrastruktur AI kini memasuki fase kedua: mulai dari chip dan HBM hingga inference dan daya, faktor-faktor ini akan menjadi pendorong utama pertumbuhan selama 2–3 tahun mendatang

Mengapa Chip dan HBM Menjadi Hotspot Awal

Dalam gelombang AI saat ini, sektor pertama yang menarik perhatian pasar modal secara terfokus hampir selalu berpusat pada chip dan memori. Alasannya jelas: iterasi cepat model besar bergantung pada kapasitas pelatihan skala besar, dengan kendala paling langsung berupa pasokan daya komputasi kelas atas. Semakin banyak GPU yang bisa diperoleh, semakin besar peluang untuk melatih model lebih besar, menyediakan layanan cloud yang lebih kuat, dan membangun moat ekosistem yang lebih dalam.

Namun, seiring peningkatan daya komputasi chip individu, bottleneck baru segera muncul. Sistem AI tidak hanya perlu "menghitung cepat", tetapi juga harus "diberi makan secara memadai". Hal ini segera meningkatkan signifikansi strategis High-Bandwidth Memory (HBM). Untuk pelatihan model besar dan inferensi berkapasitas tinggi, bandwidth memori kini menjadi variabel inti yang langsung memengaruhi throughput, latensi, dan efisiensi energi.

Laporan publik terbaru memperkuat logika ini. Reuters mencatat, manajemen SK Group memperkirakan kekurangan wafer global akan bertahan hingga 2030, dan SK Hynix menyatakan permintaan HBM diprediksi melampaui pasokan selama beberapa tahun ke depan. Ini membuktikan bahwa fokus pasar pada chip dan HBM bukan sekadar sentimen; AI benar-benar mengubah dinamika pasokan dan permintaan semikonduktor kelas atas.

Tiga alasan utama chip dan HBM menjadi hotspot awal:

- Bottleneck paling mudah terlihat: Pada fase pelatihan, kesenjangan daya komputasi paling mudah diukur dan dikenali oleh industri serta pasar modal.

- Ekspansi pasokan paling lambat: Logika kelas atas, kemasan canggih, dan HBM adalah segmen berhambatan tinggi dengan siklus ekspansi panjang, persyaratan sertifikasi ketat, dan tantangan substitusi besar.

- Transmisi harga paling langsung: Jika kekurangan pasokan berlanjut, perubahan pesanan, harga, dan keuntungan cepat tercermin dalam kinerja perusahaan.

Chip, HBM, dan kemasan canggih terus menjadi tren panas belakangan ini, sejalan dengan fundamental industri dan preferensi pasar.

Mengapa Infrastruktur AI Beralih dari Pelatihan ke Inferensi

Meski chip dan HBM tetap esensial, pusat gravitasi infrastruktur AI kini bergeser. Jika sebelumnya industri fokus pada pelatihan model, kini lebih banyak sumber daya dialokasikan untuk deployment inferensi dan operasi produksi.

Alasannya sederhana: pelatihan menentukan batas atas kapabilitas model, sementara inferensi menentukan skala komersialisasi. Pelatihan adalah aktivitas investasi tinggi yang hanya melibatkan segelintir perusahaan terdepan, sedangkan inferensi terjadi setiap kali ada permintaan pengguna nyata—mulai dari pencarian, produktivitas kantor, layanan pelanggan, iklan, pembuatan kode, pembuatan video, Q&A basis pengetahuan perusahaan, hingga otomasi Agent.

Laporan Strategi Aplikasi Enterprise F5 2026 menunjukkan 78% perusahaan sudah menjalankan inferensi AI sebagai kapabilitas operasional utama, dan 77% menilai inferensi—bukan pelatihan—sebagai skenario utama AI. Ini menandakan AI beralih dari laboratorium ke sistem produksi, dan permintaan bergeser dari “kompetisi kapabilitas model” ke “kompetisi efisiensi operasional”.

Saat AI masuk ke proses bisnis, fokus perusahaan bergeser dari ukuran parameter model ke metrik operasional seperti:

- Apakah latensi stabil?

- Apakah biaya dapat dikontrol?

- Bisakah routing dan switching antar model?

- Apakah data aman?

- Apakah hasil dapat diaudit?

- Bisakah sistem terintegrasi dengan platform bisnis yang ada?

Infrastruktur AI kini berkembang dari cluster pelatihan tunggal ke sistem operasi inferensi yang kompleks, meliputi:

- Platform layanan model

- Kerangka akselerasi inferensi

- Penjadwalan dan routing multi-model

- Pengambilan vektor dan manajemen konteks

- Sistem orkestrasi Agent

- Audit keamanan dan kontrol akses

Perubahan ini juga tercermin pada strategi vendor hardware. Rilis publik Google Cloud 2026 menegaskan fokus pada produk TPU yang dioptimalkan untuk inferensi, menonjolkan latensi rendah, konteks panjang, dan concurrency Agent skala besar. Arsitektur hardware kini bergeser dari “training-first” ke “inference-first”.

Mengapa Bottleneck Nyata Meluas ke Data Center dan Daya

Jika sebelumnya pertanyaan utama adalah “Apakah GPU tersedia?”, kini pertanyaannya menjadi “Setelah punya GPU, bisakah didistribusikan secara andal?”

Ini menandai tahap kedua infrastruktur AI. GPU tetap aset inti, tetapi hanya jika dipadukan dengan data center, daya, pendinginan, jaringan, switching, dan sistem operasi, barulah potensi produktivitas bisa diwujudkan. Bottleneck industri AI kini bergeser dari hardware individu ke kapabilitas sistem penuh.

Beberapa perkembangan publik terbaru menegaskan tren ini:

- Perusahaan teknologi Amerika Utara akan terus meningkatkan belanja modal AI pada 2026, berinvestasi pada chip, kawasan data center, arsitektur jaringan, dan ekspansi infrastruktur.

- Proyeksi energi AS memprediksi konsumsi daya mencapai rekor baru pada 2026 dan 2027, dengan data center dan AI sebagai pendorong utama.

- Proyek data center AI hyperscale kini berfokus pada pasokan daya ratusan megawatt, sewa jangka panjang, dan pengembangan kampus, menandakan industri kini fokus pada “cara mendukung daya komputasi”.

Industri AI semakin menyerupai sistem industri berat, bukan sekadar ekspansi asset-light era internet. Variabel kunci ekspansi bergeser dari “bisakah kita desain chip lebih kuat” ke “bisakah kita amankan daya, lahan, pendinginan, dan jaringan secara cepat”.

Transformasi ini membawa empat konsekuensi utama:

- Data center beralih dari aset IT ke aset strategis: Beban kerja AI berkapasitas tinggi menuntut standar baru fasilitas, distribusi daya, dan pendinginan.

- Daya menjadi sumber daya langka baru: Di beberapa wilayah, GPU bukan lagi sumber daya paling sulit didapat—akses daya stabil jangka panjang lebih langka.

- Pentingnya pendinginan dan pendinginan cair meningkat pesat: Densitas daya cluster AI meningkat, metode pendinginan tradisional makin tidak memadai.

- Interkoneksi berkecepatan tinggi menentukan efisiensi cluster: Dengan skala daya komputasi yang membesar, performa sistem makin bergantung pada arsitektur jaringan dan switching, bukan kartu individu.

Kompetisi inti infrastruktur AI kini bukan lagi soal terobosan titik tunggal, melainkan kolaborasi sistem.

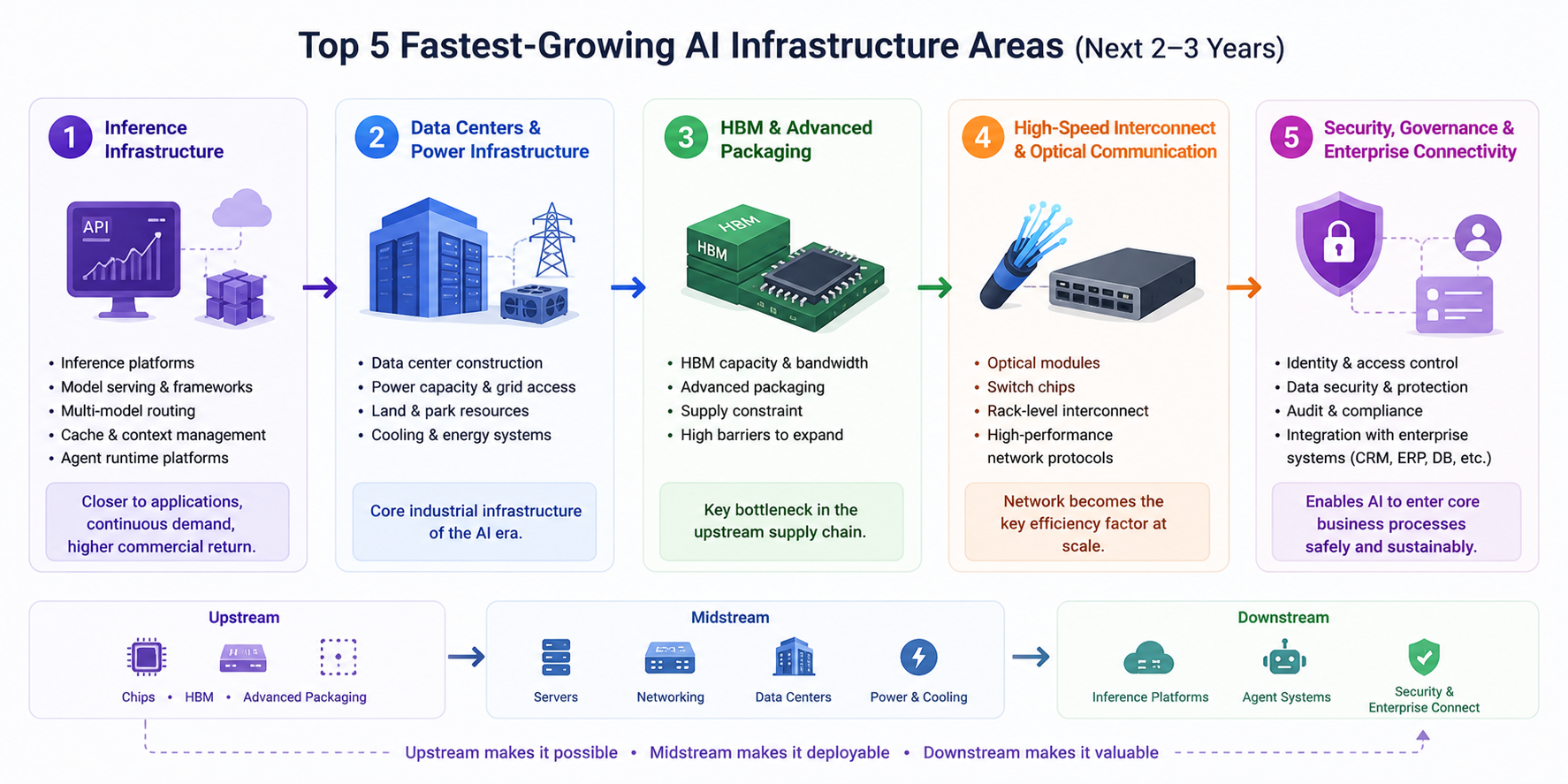

Lima Arah Pertumbuhan Tercepat dalam 2–3 Tahun Mendatang

Menurut perkembangan publik dan perubahan rantai industri, arah pertumbuhan tercepat infrastruktur AI dalam 2–3 tahun ke depan dapat dirangkum dalam lima kategori:

- Infrastruktur inferensi: Layak mendapat perhatian berkelanjutan. Aplikasi AI yang cepat masuk ke produksi mendorong perluasan platform inferensi, kerangka layanan model, routing multi-model, caching dan manajemen konteks, serta platform operasi Agent. Dibanding pelatihan, permintaan inferensi lebih terdistribusi, berkelanjutan, dan dekat dengan hasil komersial.

- Data center dan dukungan daya: Data center menjadi infrastruktur utama era AI. Mereka yang dapat mengamankan kuota daya, lahan, kondisi kampus, dan sistem pendinginan lebih cepat akan lebih siap menghadapi gelombang ekspansi daya komputasi berikutnya. Kecepatan pembangunan data center akan sangat memengaruhi pertumbuhan industri AI.

- HBM dan kemasan canggih: Tetap menjadi bottleneck paling kritis di rantai pasokan hulu. Seiring performa chip meningkat, kebutuhan kapasitas HBM, bandwidth, dan teknologi kemasan juga meningkat, sementara kapasitas terkait sulit ditingkatkan dengan cepat—prospek tinggi kemungkinan akan berlanjut.

- Interkoneksi berkecepatan tinggi dan komunikasi optik: Seiring cluster AI berkembang, jaringan menjadi variabel utama efisiensi keseluruhan. Modul optik, chip switching, interkoneksi tingkat rak, dan protokol jaringan efisien menjadi kapabilitas dasar penting untuk pelatihan dan inferensi.

- Tata kelola keamanan dan konektivitas enterprise: Meski area ini kurang menonjol dalam jangka pendek dibanding chip, nilai jangka panjangnya sangat besar. Ketika AI enterprise terintegrasi dengan CRM, ERP, database, repository kode, dan sistem pengetahuan, kontrol akses, audit, perlindungan data sensitif, pelacakan hasil, dan tata kelola kepatuhan menjadi kebutuhan utama. Lapisan ini menentukan apakah AI benar-benar masuk ke proses bisnis inti.

Jalur transmisi utama:

- Hulu: chip, HBM, kemasan canggih

- Tengah: server, jaringan switching, data center, daya, dan pendinginan

- Hilir: platform inferensi, sistem Agent, tata kelola keamanan, dan integrasi enterprise

Hulu menentukan "bisakah dibangun", tengah menentukan "bisakah didistribusikan", hilir menentukan "bisakah digunakan dan terus menciptakan nilai".

Kesimpulan: Kompetisi AI Memasuki Era Rekayasa Sistem

Beberapa tahun terakhir, pasar mengejar chip dan HBM karena sektor ini paling langka dan menawarkan cerita pasokan-permintaan paling jelas. Namun, seiring AI beralih dari perlombaan pelatihan ke deployment inferensi, logika industri berubah secara fundamental. Ke depan, penentu pertumbuhan bukan hanya performa chip individu, tetapi apakah seluruh infrastruktur dapat beroperasi secara kohesif.

Kerangka kerja untuk memahami tahap infrastruktur AI saat ini:

- Pelatihan menentukan batas atas kapabilitas

- Inferensi menentukan skala komersialisasi

- Data center dan daya menentukan kecepatan ekspansi

- Tata kelola keamanan menentukan kedalaman adopsi enterprise

Peluang gelombang infrastruktur AI berikutnya tidak terbatas pada chip, tetapi akan berkembang di “infrastruktur inferensi + data center + sistem daya + interkoneksi berkecepatan tinggi + platform tata kelola enterprise”.

Dari perspektif jangka panjang, AI berkembang dari industri kompetisi model menjadi industri rekayasa sistem. Mereka yang mampu menciptakan sinergi antara daya komputasi, jaringan, energi, dan platform operasional akan menjadi pemimpin ekspansi industri dalam 2–3 tahun ke depan.

Pengingat Risiko: Artikel ini bukan merupakan nasihat investasi dan hanya untuk tujuan informasi. Silakan berinvestasi dengan hati-hati.

Artikel Terkait

Tokenomik USD.AI: Analisis Kedalaman Kasus Penggunaan Token CHIP dan Mekanisme Insentif

Analisis Sumber Keuntungan USD.AI: Cara Pinjaman Infrastruktur AI Menghasilkan Keuntungan

Analisis Kedalaman Audiera GameFi: Cara Dance-to-Earn Memadukan AI dengan Permainan Ritme

Analisis Arsitektur Audiera Protocol: Cara Kerja Sistem Ekonomi Agent-Native

Apa Itu Fartcoin? Semua Hal yang Perlu Anda Ketahui Tentang FARTCOIN