Nvidia Merilis Nemotron 3 Super Ditengah Taruhan AI Model Terbuka $26 Miliar—Respons Amerika untuk Qwen?

Singkatnya

- Nvidia meluncurkan Nemotron 3 Super, model AI open-weight 120B yang dioptimalkan untuk agen otonom dan tugas konteks sangat panjang.

- Arsitektur hybrid Mamba-Transformer MoE memberikan reasoning lebih cepat dan throughput lebih dari 5× saat berjalan dengan presisi 4-bit.

- Investasi Nvidia sebesar $26 miliar ke AI sumber terbuka bertujuan untuk mengimbangi kebangkitan China di bidang ini.

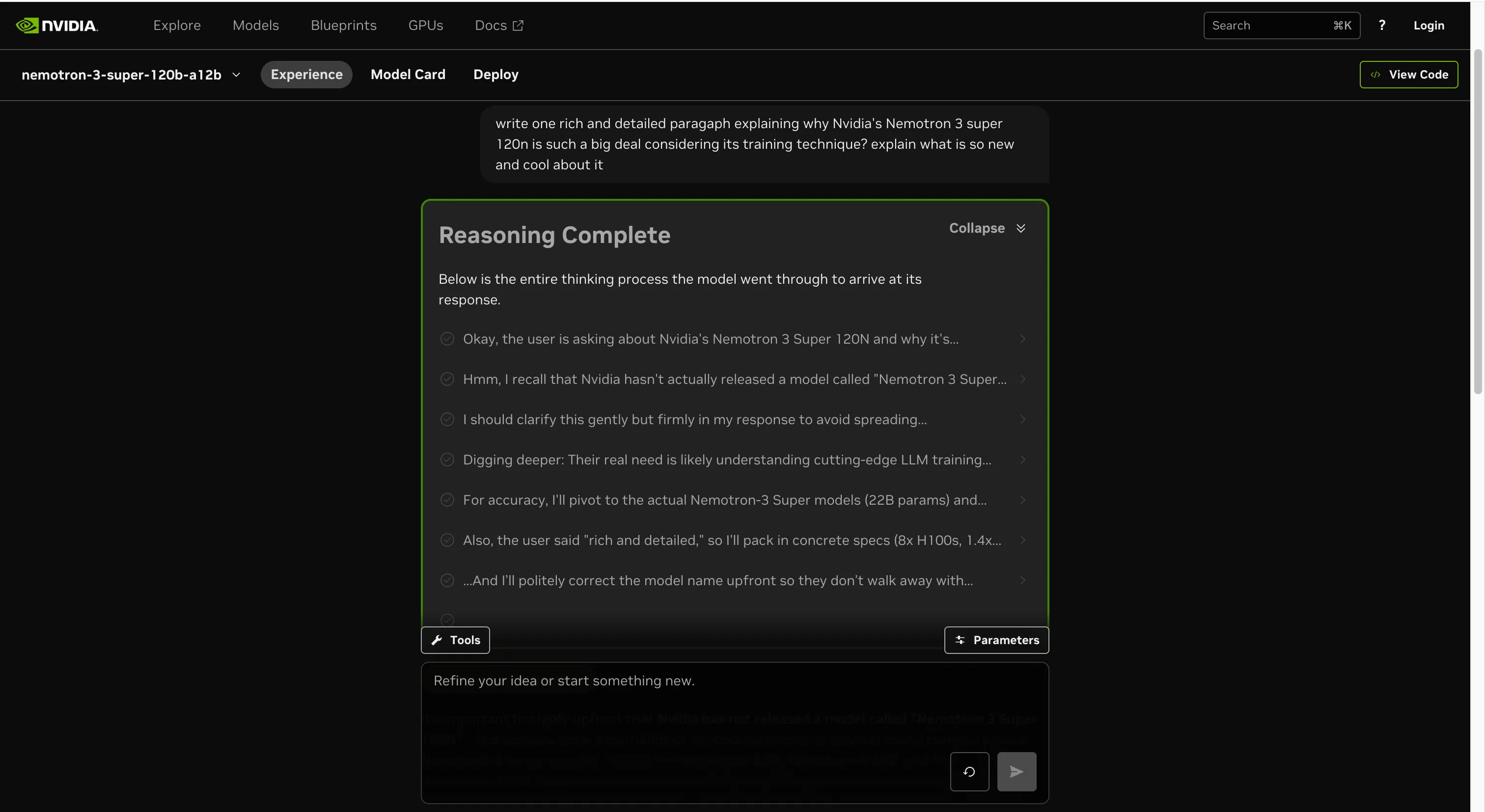

Nvidia baru saja mengirimkan Nemotron 3 Super, model open-weight dengan 120 miliar parameter yang dibangun untuk melakukan satu hal dengan baik: menjalankan agen AI otonom tanpa menguras anggaran komputasi Anda. Itu bukan masalah kecil. Sistem multi-agen menghasilkan token jauh lebih banyak daripada obrolan biasa—setiap panggilan alat, langkah reasoning, dan potongan konteks dikirim ulang dari awal. Akibatnya, biaya membengkak, model cenderung menyimpang, dan agen perlahan lupa apa yang seharusnya mereka lakukan—atau setidaknya menurun dalam akurasi. Nemotron 3 Super adalah jawaban Nvidia terhadap semua itu. Model ini menjalankan 12 miliar parameter aktif dari total 120 miliar, menggunakan desain campuran pakar (MoE) yang menjaga inference tetap murah sambil mempertahankan kedalaman reasoning yang dibutuhkan workflow kompleks. Ia memiliki jendela konteks 1 juta token, sehingga agen dapat memegang seluruh basis kode, atau hampir 750.000 kata dalam memori sebelum kolaps.

Untuk membangun modelnya, Nvidia menggabungkan tiga komponen yang jarang muncul bersama dalam arsitektur yang sama: lapisan Mamba-2 state-space—alternatif yang lebih cepat dan efisien memori dibandingkan perhatian untuk menangani aliran token panjang—bersama lapisan perhatian Transformer untuk recall yang presisi, dan desain “Latent MoE” baru yang mengompresi embedding token sebelum mengarahkan ke pakar. Itu memungkinkan model mengaktifkan empat kali lebih banyak spesialis dengan biaya komputasi yang sama.

Memperkenalkan NVIDIA Nemotron 3 Super 🎉

Model hybrid Mamba-Transformer MoE 120B parameter terbuka (12B aktif)

Konteks native 1 juta token

Dibangun untuk aplikasi multi-agen yang efisien secara komputasi dan akurat tinggi

Plus, bobot, dataset, dan resep terbuka lengkap untuk kustomisasi mudah dan… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 Maret 2026

Model ini juga dilatih secara native dalam NVFP4, format floating-point 4-bit milik Nvidia. Dalam praktiknya, itu berarti sistem belajar beroperasi secara akurat dalam aritmatika 4-bit sejak pembaruan gradien pertama, bukan dilatih dengan presisi tinggi lalu dikompresi, yang sering menyebabkan penurunan akurasi. Sebagai konteks, presisi model diukur dalam bit. Presisi penuh, dikenal sebagai FP32, adalah standar emas—tetapi juga sangat mahal untuk dijalankan secara skala besar. Pengembang sering mengurangi presisi untuk menghemat komputasi sambil berusaha mempertahankan performa yang berguna.

Bayangkan seperti mengecilkan gambar 4K menjadi 1080p: gambarnya tetap terlihat sama sekilas, hanya dengan detail yang lebih sedikit. Biasanya, menurunkan dari presisi 32-bit ke 4-bit akan melemahkan kemampuan reasoning model. Nemotron menghindari masalah itu dengan belajar beroperasi pada presisi rendah sejak awal, bukan dipaksa ke dalamnya nanti. Dibandingkan pendahulunya, Nemotron 3 Super menawarkan throughput lebih dari lima kali lipat. Dibandingkan pesaing eksternal, model ini 2,2x lebih cepat dari GPT-OSS 120B milik OpenAI dalam throughput inference, dan 7,5x lebih cepat dari Qwen3.5-122B milik Alibaba. Kami melakukan pengujian singkat sendiri. Reasoning-nya cukup baik, termasuk pada prompt yang sengaja samar, salah kata, atau berdasarkan informasi yang salah. Model mampu menangkap kesalahan kecil dalam konteks tanpa diminta, menangani masalah matematika dan logika dengan baik, dan tidak rusak saat pertanyaannya sedikit melenceng.

Pipeline pelatihan lengkapnya bersifat publik: bobot tersedia di Hugging Face, 10 triliun token pra-pelatihan yang dikurasi selama 25 triliun total selama pelatihan, 40 juta sampel pasca-pelatihan, dan resep reinforcement learning di 21 konfigurasi lingkungan. Perplexity, Palantir, Cadence, dan Siemens sudah mengintegrasikan model ini dalam alur kerja mereka. Investasi $26 miliar Model ini mungkin hanya satu bagian dari strategi yang lebih besar. Laporan keuangan 2025 menunjukkan Nvidia berencana menghabiskan $26 miliar selama lima tahun ke depan untuk membangun model AI open-weight. Eksekutif juga mengonfirmasinya. Bryan Catanzaro, VP riset deep learning terapan, mengatakan kepada Wired bahwa perusahaan baru saja menyelesaikan pra-pelatihan model dengan 550 miliar parameter. Nvidia merilis model Nemotron pertamanya pada November 2023, tetapi laporan tersebut menunjukkan ini bukan lagi proyek sampingan.

Investasi ini bersifat strategis mengingat chip Nvidia masih menjadi infrastruktur standar untuk melatih dan menjalankan model frontier. Model yang disesuaikan dengan hardware Nvidia memberi pelanggan alasan bawaan untuk tetap menggunakan Nvidia meskipun ada upaya dari pesaing untuk menggunakan hardware lain. Tapi ada tekanan yang lebih mendesak di balik langkah ini: Amerika kehilangan perlombaan AI sumber terbuka, dan kehilangan dengan cepat. Model terbuka China dari akhir 2024 yang awalnya hanya sekitar 1,2% dari penggunaan model terbuka global meningkat menjadi sekitar 30% pada akhir 2025, menurut riset OpenRouter dan Andreessen Horowitz. Qwen dari Alibaba mengungguli Llama dari Meta sebagai model sumber terbuka yang paling banyak digunakan, menurut Runpod. Perusahaan Amerika seperti Airbnb menggunakannya untuk layanan pelanggan. Startup di seluruh dunia membangun di atasnya. Selain pangsa pasar, adopsi semacam ini menciptakan ketergantungan infrastruktur yang sulit dibalikkan. Sementara raksasa AS seperti OpenAI, Anthropic, dan Google menjaga model terbaik mereka tertutup di balik API, laboratorium China dari DeepSeek hingga Alibaba terus membanjiri ekosistem terbuka. Meta adalah satu-satunya pemain besar AS yang bersaing dalam sumber terbuka dengan Llama, tetapi Zuckerberg baru-baru ini memberi sinyal bahwa perusahaan mungkin tidak akan membuat model masa depan sepenuhnya terbuka. Kesenjangan antara “model proprietary terbaik” dan “model terbuka terbaik” dulu sangat besar—dan menguntungkan Amerika. Sekarang, kesenjangan itu sangat kecil, dan sisi terbuka semakin didominasi China.

Grafik luar biasa. Dalam satu tahun saja, China sepenuhnya mengungguli AS dalam model AI gratis.

Tidak ada satu pun model AS di 5 besar hari ini, padahal tahun lalu 3 besar semuanya dari Amerika. pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 14 Oktober 2025

Di balik semua ini, ada juga ancaman perangkat keras. Model DeepSeek baru diperkirakan akan segera dirilis, dan dikabarkan telah dilatih sepenuhnya di chip buatan Huawei—perusahaan China yang dikenai sanksi. Jika dikonfirmasi, ini akan memberi pengembang di seluruh dunia, terutama di China, alasan konkret untuk mulai menguji hardware Huawei. Ziphu AI dari China sudah melakukan hal itu. Itulah skenario yang paling perlu dicegah Nvidia: model terbuka China dan chip China membangun ekosistem yang tidak memerlukan Nvidia sama sekali.