Nvidia تطلق Nemotron 3 Super وسط $26 مليار دولار رهان على نماذج ذكاء اصطناعي مفتوحة المصدر—هل تكون هذه إجابة أمريكا على Qwen؟

باختصار

- أطلقت Nvidia نموذج Nemotron 3 Super، وهو نموذج ذكاء اصطناعي مفتوح الوزن ب120 مليار معلمة، مُحسن للوكيلات الذاتية المهام وسياقات طويلة جدًا.

- يوفر هيكل Mamba-Transformer Hybrid MoE سرعة استنتاج أعلى بأكثر من 5 مرات من خلال تشغيله بدقة 4-بت.

- تستثمر Nvidia 26 مليار دولار في الذكاء الاصطناعي مفتوح المصدر لمواجهة صعود الصين في هذا المجال.

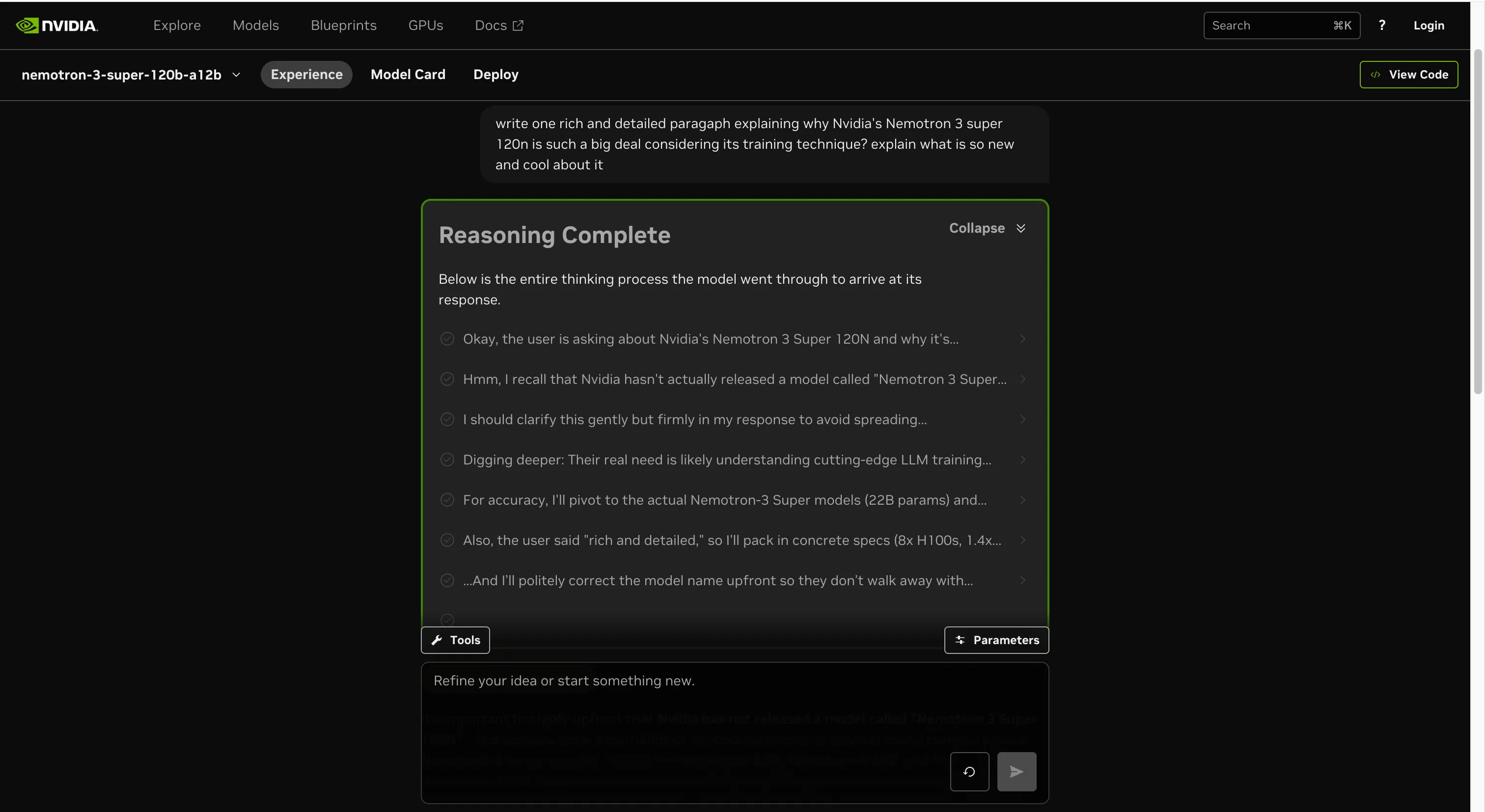

قامت Nvidia مؤخرًا بشحن نموذج Nemotron 3 Super، وهو نموذج مفتوح الوزن ب120 مليار معلمة، مصمم لأداء مهمة واحدة بشكل ممتاز: تشغيل وكلاء الذكاء الاصطناعي الذاتيين دون استنزاف ميزانية الحوسبة الخاصة بك. هذه ليست مشكلة صغيرة. أنظمة الوكيل المتعددة تولد عددًا أكبر بكثير من الرموز مقارنة بالدردشة العادية — كل استدعاء أداة، خطوة استنتاج، وقطعة من السياق يتم إعادة إرسالها من البداية. ونتيجة لذلك، تتضاعف التكاليف، ويميل النموذج إلى الانحراف، ويبدأ الوكلاء في نسيان ما كان من المفترض أن يفعلوه في المقام الأول… أو على الأقل ينقص دقته. يعد Nemotron 3 Super رد Nvidia على كل ذلك. يعمل النموذج على 12 مليار معلمة نشطة من أصل 120 مليار، باستخدام تصميم مختلط من الخبراء (MoE) يحافظ على استنتاج منخفض التكلفة مع الاحتفاظ بعمق الاستدلال الذي تتطلبه سير العمل المعقدة. يحتوي على نافذة سياق تصل إلى مليون رمز، بحيث يمكن للوكلاء الاحتفاظ بكود كامل، أو ما يقرب من 750,000 كلمة في الذاكرة قبل الانهيار.

لبناء نموذجه، دمجت Nvidia ثلاثة مكونات نادرًا ما تظهر معًا في نفس الهيكل: طبقات Mamba-2 ذات مساحة الحالة — وهي بديل أسرع وأكثر كفاءة في الذاكرة للانتباه لمعالجة تدفقات الرموز الطويلة — إلى جانب طبقات انتباه Transformer لاستدعاء دقيق، وتصميم “Latent MoE” الجديد الذي يضغط تمثيلات الرموز قبل توجيهها إلى الخبراء. هذا يسمح للنموذج بتنشيط أربعة أضعاف عدد المتخصصين بنفس تكلفة الحوسبة.

تقديم NVIDIA Nemotron 3 Super 🎉

نموذج هجين Mamba-Transformer MoE ب120 مليار معلمة (12 مليار نشطة)

سياق أصلي ب1 مليون رمز

مصمم لتطبيقات متعددة الوكيل عالية الدقة وفعالة في الحوسبة

بالإضافة إلى ذلك، الأوزان، مجموعات البيانات، والوصفات مفتوحة المصدر لسهولة التخصيص… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 مارس 2026

تم أيضًا تدريب النموذج بشكل أصلي باستخدام NVFP4، وهو تنسيق الأرقام العائمة 4-بت الخاص بـ Nvidia. في الممارسة العملية، يعني ذلك أن النظام تعلم العمل بدقة 4-بت من أول تحديث تدرجي، بدلاً من تدريبه بدقة عالية وضغطه لاحقًا، مما غالبًا ما يتسبب في فقدان الدقة. للفهم، يتم قياس دقة النموذج بالبتات. الدقة الكاملة، المعروفة باسم FP32، هي المعيار الذهبي — لكنها أيضًا مكلفة جدًا للتشغيل على نطاق واسع. غالبًا ما يقلل المطورون من الدقة لتوفير الحوسبة مع محاولة الحفاظ على الأداء المفيد.

فكر في الأمر كتصغير صورة 4K إلى 1080p: لا تزال الصورة تبدو كما هي عند النظرة الأولى، مع تقليل التفاصيل فقط. عادةً، فإن تقليل الدقة من 32-بت إلى 4-بت سيعطل قدرة النموذج على الاستنتاج. يتجنب Nemotron هذه المشكلة من خلال التعلم للعمل بدقة منخفضة من البداية، بدلاً من أن يُضغط فيها لاحقًا. مقارنة بسابقه، يوفر Nemotron 3 Super أكثر من خمسة أضعاف معدل الإنتاجية. مقارنة بالمنافسين الخارجيين، هو أسرع بمقدار 2.2 مرة من GPT-OSS 120B من OpenAI من حيث معدل الاستنتاج، وأسرع بمقدار 7.5 مرة من Qwen3.5-122B من Alibaba. قمنا بإجراء اختبار سريع خاص بنا. استمر الاستنتاج بشكل جيد، حتى مع الطلبات التي كانت غامضة عمدًا، أو مكتوبة بشكل سيء، أو تعتمد على معلومات خاطئة. اكتشف النموذج أخطاء صغيرة في السياق دون أن يُطلب منه، وتعامل مع مسائل الرياضيات والمنطق بشكل نظيف، ولم يتفكك عندما كانت الأسئلة غير دقيقة قليلاً.

خط أنابيب التدريب الكامل متاح للجميع: الأوزان على Hugging Face، مع 10 تريليون رمز تدريب منقح تم مشاهدته خلال 25 تريليون إجمالي أثناء التدريب، و40 مليون عينة بعد التدريب، ووصفات التعلم المعزز عبر 21 تكوين بيئي. يتم بالفعل دمج نماذج Perplexity و Palantir و Cadence و Siemens في سير عملهم. الاستثمار بقيمة 26 مليار دولار قد يكون النموذج جزءًا من استراتيجية أكبر. تظهر وثيقة مالية لعام 2025 أن Nvidia تخطط لإنفاق 26 مليار دولار على مدى السنوات الخمس القادمة لبناء نماذج ذكاء اصطناعي مفتوحة الوزن. وأكد المسؤولون التنفيذيون ذلك أيضًا. قال بريان كاتانزارو، نائب رئيس أبحاث التعلم العميق التطبيقية، لـ Wired إن الشركة أنهت مؤخرًا تدريب نموذج ب550 مليار معلمة. أصدرت Nvidia أول نموذج Nemotron في نوفمبر 2023، لكن تلك الوثيقة توضح أن الأمر لم يعد مشروعًا جانبيًا.

الاستثمار استراتيجي بالنظر إلى أن رقائق Nvidia لا تزال البنية التحتية الافتراضية الأساسية لتدريب وتشغيل النماذج المتقدمة. النماذج المعدلة لتتناسب مع أجهزتها تعطي العملاء سببًا مدمجًا للبقاء على Nvidia على الرغم من جهود المنافسين لاستخدام أجهزة أخرى. لكن هناك ضغطًا أكثر إلحاحًا وراء ذلك: تفقد أمريكا سباق الذكاء الاصطناعي مفتوح المصدر بسرعة. انتقلت النماذج المفتوحة الصينية من أقل من 1.2% من الاستخدام العالمي للنماذج المفتوحة في أواخر 2024 إلى حوالي 30% بحلول نهاية 2025، وفقًا لأبحاث OpenRouter و Andreessen Horowitz. تجاوزت Qwen من Alibaba نموذج Meta Llama كأكثر نموذج مفتوح المصدر يُستخدم ذاتيًا، وفقًا لـ Runpod. اعتمدت شركات أمريكية مثل Airbnb على ذلك لخدمة العملاء. تبني الشركات الناشئة حول العالم على ذلك. بالإضافة إلى حصة السوق، يخلق هذا النوع من الاعتماد بنية تحتية يصعب عكسها. بينما تظل الشركات الكبرى في الولايات المتحدة مثل OpenAI و Anthropic و Google تحتفظ بأفضل نماذجها خلف واجهات برمجة التطبيقات، فإن المختبرات الصينية من DeepSeek إلى Alibaba تغمر النظام البيئي المفتوح. كانت Meta اللاعب الأمريكي الرئيسي الذي ينافس في المصدر المفتوح مع Llama، لكن زوكربيرج أشار مؤخرًا إلى أن الشركة قد لا تجعل النماذج المستقبلية مفتوحة بالكامل. الفجوة بين “أفضل نموذج مملوك” و"أفضل نموذج مفتوح" كانت ضخمة — وكانت لصالح أمريكا. الآن، أصبحت الفجوة صغيرة جدًا، والجانب المفتوح من السجل يزداد صينيًا.

رسم بياني مذهل. خلال عام واحد فقط، تجاوزت الصين الولايات المتحدة تمامًا في نماذج الذكاء الاصطناعي المجانية.

لا يوجد أي نموذج أمريكي في الخمسة الأوائل اليوم، بينما كانت الثلاثة الأوائل العام الماضي جميعها أمريكية. pic.twitter.com/34ErpBv8rg

— أرنو برتراند (@RnaudBertrand) 14 أكتوبر 2025

هناك أيضًا تهديد من الأجهزة تحت كل هذا. من المتوقع على نطاق واسع أن يتم إصدار نموذج DeepSeek جديد قريبًا، ويُشاع أنه تم تدريبه بالكامل على رقائق صنعتها Huawei — شركة صينية خاضعة للعقوبات. إذا تم تأكيد ذلك، فسيعطي المطورين حول العالم، وخصوصًا في الصين، سببًا ملموسًا لبدء اختبار أجهزة Huawei. شركة Ziphu AI الصينية تفعل ذلك بالفعل. هذه هي السيناريو الذي تحتاج Nvidia أكثر إلى منعه: نماذج مفتوحة صينية ورقائق صينية تبني نظامًا بيئيًا لا يحتاج إلى Nvidia على الإطلاق.